מי יותר חכם – ילד או בוט?

הדור הצעיר גדל בעולם שבינה מלאכותית היא חלק בלתי נפרד ממנו. לצד היתרונות של כלים אלו, יש גם סכנות. מה הן, ואיך אפשר למזער אותן?

17 פברואר 2026

|

5 דקות

|

הם עונים כמעט על כל שאלה, מייצרים עבורנו תוכן, מציעים רעיונות יצירתיים ואפילו מחוללים סיפורים ותמונות. מאז שבוטים מחוללים מבוססי בינה מלאכותית נכנסו לחיינו, הם הפכו תוך זמן קצר לעוזרים דיגיטליים רבי-עוצמה. כלים כמו צ’אט-GPT, ג’מיני, Midjourney ו-DALL-E הפכו לפופולריים יותר ויותר, וגם ילדים ובני נוער משתמשים בהם. אחד היתרונות המרכזיים שמיוחסים לבוטים אלו הוא תרומתם ללמידה ולהנגשת ידע: הם יכולים, למשל, לספק הסברים מהירים, לגשת למאגרי מידע, ולעזור בסיעור מוחות כאשר תלמידים זקוקים לעזרה נוספת. כלים כאלה יכולים גם לשפר את היצירתיות: ילדים משתמשים בהם כבן שיח להעלאת רעיונות ולפיתוח פרויקטים, בבית הספר ומחוצה לו. אך האם יש לכך מחיר?

חשיבה, פרטיות ומידע שגוי

לצד היתרונות יש גם סכנות בשימוש לא מבוקר בבינה מלאכותית, במיוחד כמשמדובר על ילדים שעדיין לא פיתחו את היכולת להעריך באופן ביקורתי את התוצרים, ולהבין איך הכלים הללו פועלים או מה המגבלות שלהם. מומחים מזהירים מפני פגיעה בחשיבה הביקורתית וביצירתיות בעקבות הסתמכות יתר על בוטים מחוללים. לטענתם, שימוש תכוף בכלים שמספקים תשובות מוכנות ומיידיות עלול לצמצם חקירה עצמאית וחשיבה מעמיקה. ואכן, מחקרים מצביעים על קשר בין שימוש גובר בכלים מבוססי בינה מלאכותית לבין ירידה ביכולות החשיבה הביקורתית. מחקר שבחן פעילות המוחית בזמן שימוש בצ’אט-GPT מצא שככל שההסתמכות על הבוט עולה, כך יורדת הפעילות המוחית הקשורה ליצירתיות, זיכרון ושליטה קוגניטיבית, והחשיבה נעשית ״שטחית״ יותר.

חשש נוסף נוגע לפגיעה בפרטיות. ילדים עשויים לשתף בשיחה עם הצ׳אט במידע אישי בלי להבין כמה הוא חשוף, אם הוא נשמר במאגרי החברה שמפעילה את הבוט, ולאלו שימושים עתידיים הוא עשוי להגיע. תוכן השיחות יכול לשמש לאימון מודלים מתקדמים, לדלוף לרשת ואף לשמש כראיה בבתי משפט. סכנה נוספת היא הקושי להבחין בין מידע אמיתי לשגוי. הצ’אט יכול להמציא עובדות – תופעה שמכונה “הזיות של בינה מלאכותית“, ולהציג אותן בצורה משכנעת ומנוסחת היטב, שגורמת למשתמשים לבטוח בתוכן זה. עבור ילדים, שיכולת הביקורת שלהם עדיין מתפתחת, הסכנה גדולה במיוחד: הם נוטים לבטוח במידע שמוצג באופן סמכותי, בעולם שבו צ׳אטבוטים נתפסים כמקור מידע לגיטימי.

אונסק”ו, ארגון החינוך, מדע ותרבות של האו״ם, ציין כי אף שבינה מלאכותית משפיעה יותר ויותר על חייהם של הילדים, הם כמעט שאינם נלקחים בחשבון בתהליכי התכנון, הפיתוח וההפצה של כלים אלו. כך נוצר מצב שטכנולוגיות בינה מלאכותית אינן מותאמות לצרכים ולרגישויות הייחודיים של ילדים.

יש גם סכנות בשימוש לא מבוקר בבינה מלאכותית, במיוחד כמשמדובר על ילדים שעדיין לא פיתחו את היכולת להעריך באופן ביקורתי את התוצרים. ילדים בכיתה משתמשים במחשבים | Shutterstock, Gorodenkoff

שיעור בכישורי בינה

מחקרים שונים מנסים להבין עד כמה ילדים סומכים על תוצרים של בינה מלאכותית, ומה הן המשמעויות של שימוש בכלים אלו בגיל צעיר. במקביל, נעשים ניסיונות לפתח מתודולוגיות שיציידו ילדים במיומנויות הערכה ביקורתית, יסייעו להם להבין את נקודות החוזק והחולשה של הבינה המלאכותית, ויכוונו אותם לשימוש מושכל בה. הנתונים שהגיעו ממספר מחקרים מצביעים על הזדמנות דווקא בגילים צעירים, שבהם ילדים מצליחים לפתח גישה ספקנית כלפי מקורות מלאכותיים.

במחקר שבדק את רמות האמון שנותנים ילדים בבני אדם לעומת ברובוטים, ילדים בני 5-3 צפו בסרטונים קצרים שבהם הוצגו להם חפצים מוכרים, כמו כדור או תפוח. מבוגר אנושי או רובוט נתנו להם שמות נכונים או שגויים, למשל כשהילדים ראו תפוח נאמר להם “תראו! זו כף!”. לאחר מכן הילדים נשאלו אם הם חושבים שהמבוגר או הרובוט נותנים להם מידע אמין. בשלב הבא הוצגו לילדים חפצים חדשים שאותם הם לא הכירו, ושוב המבוגר או הרובוט הציגו את שמותיהם. החוקרים בדקו אם הילדים יאמצו את השמות שהציע האדם או הרובוט. תוצאות המחקר הראו שילדים סומכים על רובוטים כל עוד הוכיחו דיוק בעבר, אך לא אם הטעו אותם בשלב של החפצים המוכרים. לעומת זאת, התגובה לבני אדם משתנה עם הגיל: ילדים גדולים יותר נטו לפקפק הן בבני אדם והן ברובוטים שעשו טעויות, וילדים צעירים נטו להמשיך לבטוח בבני אדם שטעו, אך לא ברובוטים.

במחקר ראו הילדים חפצים, ומבוגר אנושי או רובוט נתנו להם שמות נכונים או שגויים לאותם חפצים. ילד רואה במחשב רובוט שנותן לו מידע | SUTD

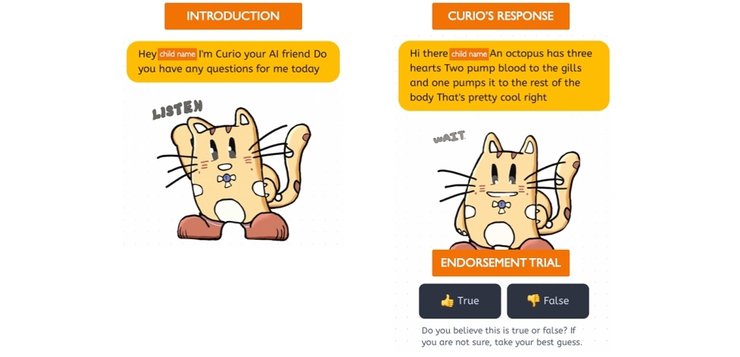

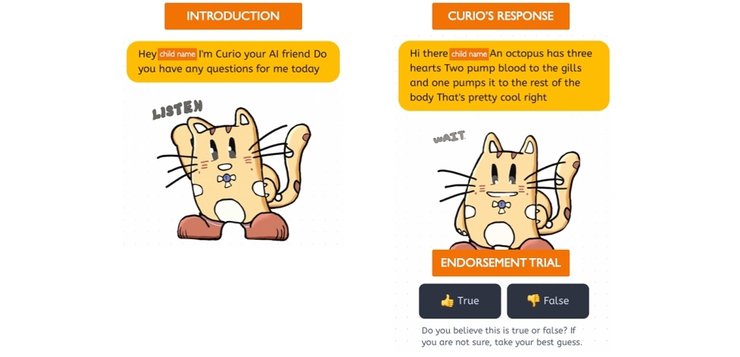

במחקר אחר שוחחו ילדים בני 6 עד 10 עם צ’אטבוט בשם קיוריו (Curio), דמות של חתול שנועדה להיראות ידידותית ולעודד שאלות. הילדים יכלו לשאול את הבוט כל שאלה שרצו, והחוקרים עקבו אחרי השיחה ובחנו כיצד הילדים מגיבים לתשובות שקיבלו. נמצא כי הילדים נטו להאמין לבוט, אך גם בחנו את תשובותיו באמצעות שאלות המשך והשוואה לידע קודם. כאשר חשדו שהמידע אינו מדויק, הם השוו אותו למה שהם כבר יודעים.

בשני המחקרים הוצגה לילדים דמות עם חזות לא אנושית – רובוט או חתול – מה שמדגיש את מלאכותיות בן השיח. זאת מכיוון שיש מחקרים שמראים שילדים צעירים רגישים יותר למאפיינים של עיצוב הרובוט, הן חיצונית והן התנהגותית: ככל שהרובוט נראה אנושי יותר, כך הם נוטים לייחס לו תכונות אנושיות, ולהתייחס אליו כאל יצור חברתי בעל בחירה ורצון. ילדים גדולים יותר, וגם מבוגרים, מבינים בדרך כלל שרובוטים הם מכונות, אך דווקא הם נוטים יותר לסמוך על המידע שהם מספקים.

ילדים בני 6 עד 10 עם צ’אטבוט בשם קיוריו, דמות של חתול שנועדה להיראות ידידותית ולעודד שאלות. החתול קיוריו מציג את עצמו ועונה לשאלה | מתוך המאמר Oh et al 2025

כשהבינה טועה

מחקר שפורסם לאחרונה רצה לבדוק אלו מגבלות של בינה מלאכותית מזהים ילדים בני 11-6, וכיצד שילוב של מידע חזותי ומילולי יכול לעזור להם בהערכה ביקורתית. החוקרים השתמשו בחידות חזותיות שתוכננו להיות קשות למחשבים אך קלות לבני אדם. הילדים נדרשו לזהות תבניות בתמונות – כמו לוח משבצות קטן שנצבע לפי חוקיות מסוימת – וליצור תמונה חדשה על פי אותה חוקיות, ולאחר מכן להשוות את פתרונם לזו של הבינה המלאכותית.

לאחר שהילדים פתרו את המטלה, הם נחשפו לפתרון של הבינה המלאכותית, ויכלו להשוות אותו לשלהם. הם גם שאלו את הצ’אט כיצד הגיע לפתרון שלו, וכך נחשפו ל״תהליך החשיבה״ של הבינה המלאכותית. באופן זה החוקרים בחנו אם השימוש בחידות אלו אפשרו לילדים לזהות שגיאות וחוסר עקביות בתשובות הבינה המלאכותית. כך למשל, המקרים שבהם הילדים זיהו כי הצ’אט נתן פתרון נכון, אך היתה חוסר התאמה בין ההסבר שהצ’אט נתן לתהליך הפתרון, הובילו את הילדים לפתח חשיבה ביקורתית יותר. על פי החוקרים מתודולוגיה זו עזרה לילדים להבין שהבינה ניגשת לפתרון בעיות בצורה שונה מבני אדם, ושיש לה מגבלות. החוקרים הדגישו שמערכות בינה מלאכותית לילדים צריכות לא רק להציג מידע, אלא גם לעזור לילדים לבצע הערכה של אמינותו ודיוקו. עם זאת, מחקר זה היה תצפיתי והתמקד בחידות חזותיות ספציפיות בלבד, ולכן הוא מוגבל ביכולת ההכללה שלו לאינטראקציות אחרות ופתוחות יותר.

לאחר שהילדים פתרו את המטלה, הם נחשפו לפתרון של הבינה המלאכותית, ויכלו להשוות אותו לשלהם. ילדים צופים בפתרון של הבינה המלאכותית | University of Washington

לא מעט חוקרים טוענים שאוריינות של בינה מלאכותית חיונית לפיתוח הבנה ביקורתית של תוצרי הכלים האלו. חוסר הבנה כיצד הם פועלים עלול להוביל לתפיסות מוטעות, ציפיות לא מציאותיות, ולקושי בזיהוי הטיות וסטריאוטיפים – בעיקר אצל ילדים. הבנת אופן הפעולה של מודלים כמו צ’אט-GPT – המתבססים על זיהוי דפוסים סטטיסטיים בטקסטים אנושיים – יכולה לסייע להבחין בין משימות שבהן הם מצטיינים לבין כאלה שבהן הם מתקשים, כמו למשל יישום ידע בהקשרים חדשים וביצוע תהליכים מורכבים הדורשים הבנה עמוקה. מגבלות אלו עלולות להוביל לתוצרים שגויים, ולחיזוק תפיסות מוטעות.

חשוב לציין שהמחקר בתחום עדיין בתחילתו. אין עוד תשובה חד-משמעית לגבי מידת האמון שילדים נותנים בבינה מלאכותית או באופן הנכון לחשוף וללמד אותם להשתמש בכלים אלו. בינתיים, חשוב להכיר הן את היתרונות והן את החסרונות, ולסייע לילדים – וגם לעצמנו – לנווט ביניהם בחוכמה.